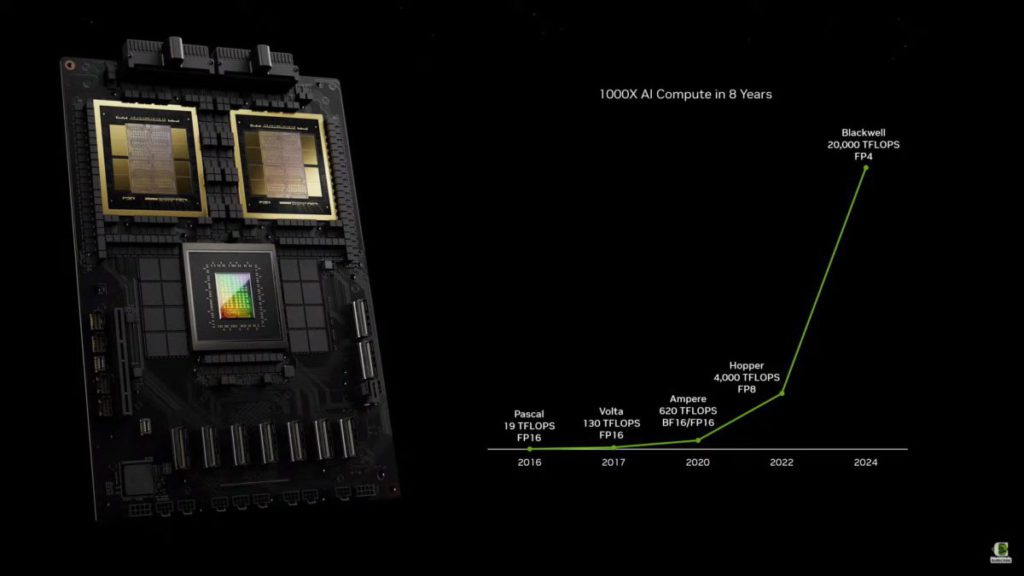

NVIDIA 於當地時間 3 月 18 日舉行的 GTC 2024 大會中發表 GPU 平台「Blackwell」,AI 效能較上一代 Hopper GPU (H100) 提升 5 倍,稱可以建構和運行具有萬億參數的即時生成式 AI。

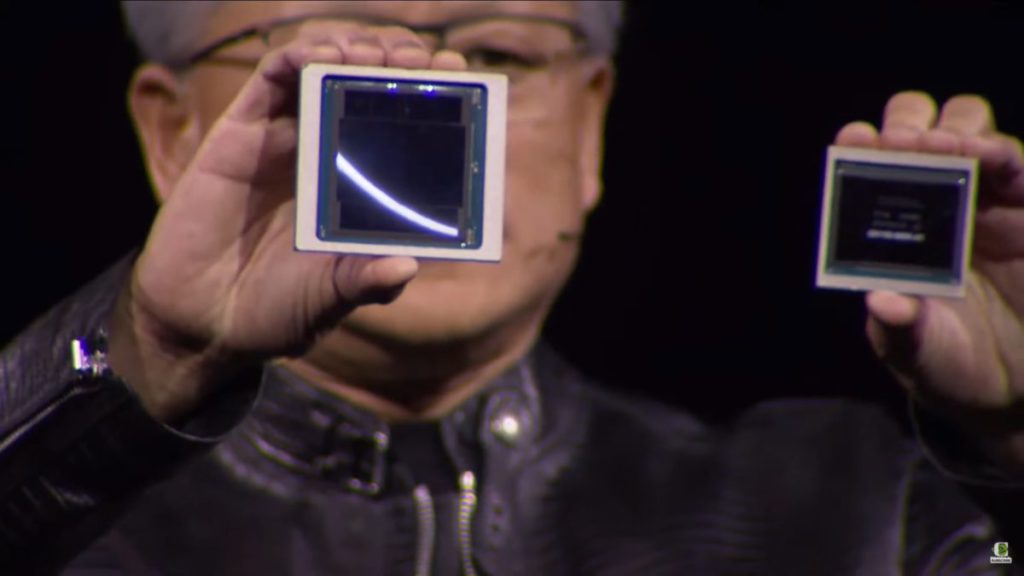

Blackwell 命名取自美國黑人數學家 David Blackwell。NVIDIA CEO 黃仁勳在 GTC 主題演講中發表 Blackwell 核心、GPU (B200)、以它來構築的 GB200 Grace Blackwell 超級晶片,與及建構提供 645 exaFLOPS 人工智能效能(exa 是 tera 的 100 萬倍)、13PB 高速記憶體的整套數據中心基建架構。

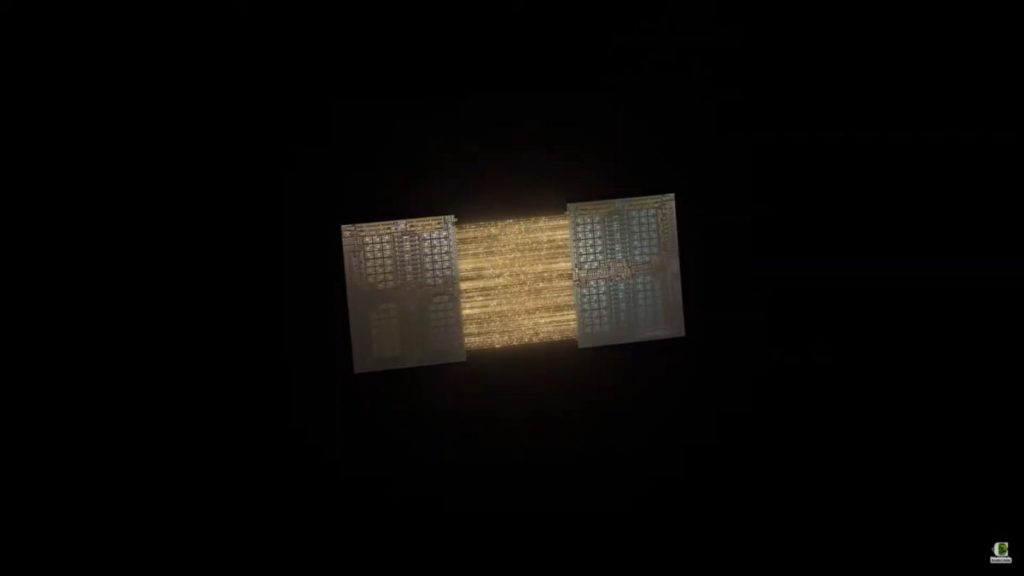

Blackwell 核心備有 1,040 億個電晶體,以 TSMC 4NP 製程生產,備有 10TB/s NVIDIA 高頻寬界面;而 Blackwell GPU 就由兩個核心連接而成,共有 2,080 億個電晶體。

與上一代的 Hopper GPU 比較,Blackwell GPU 尺寸大一倍,電晶體多 1,280 億,AI 效能提升 5 倍達 20 petaFLOPS,而核心內的記憶體就增加 4 倍達 192GB HBM3e 高頻寬記憶體,記憶體頻寬達 8TB/s。

而超級晶片 GB200 Grace Blackwell 就是將兩粒 Blackwell GPU 與 1 粒 Grace 數據中心 CPU 連接起來,AI 效能高達 40 petaFLOPS,備有 864GB 高速記憶體,記憶體頻寬達 16GB/s,並配備頻寬達 3.6GB/s 的 NVLink。兩粒 GB200 超級晶片就構成一個 Blackwell 運算節點。而一個 GB200 NVL72 水冷機櫃就有 18 個運算節點托盤,合共可配備 36 粒 GB200 超級晶片。如果按照 NVIDIA 的完整數據中心架構,整個數據中心將備有 32,000 粒 GPU,提供 645 exaFLOPS 人工智能效能。

至於耗電方面,NVIDIA 指出訓練 1.8 萬億參數的 AI 模型(GPT-3 規模),如果用 8,000 粒上代 Hopper GPU 的話,需要消耗 15MW 電力,但用新的 GB200 超級晶片的話,2,000 粒就足夠,而且只耗用 4MW 電力。

Blackwell 平台產品將會在今年下半年開始供貨,預計各大科技企業如 AWS、Google、Meta、Microsoft、OpenAI、Oracle、Tesla 和 xAI 等都會採用,而 AWS、Google Cloud、Microsoft Azure 及 Oracle 亦預計會在下半年提供配備 Blackwell 的執行個體。